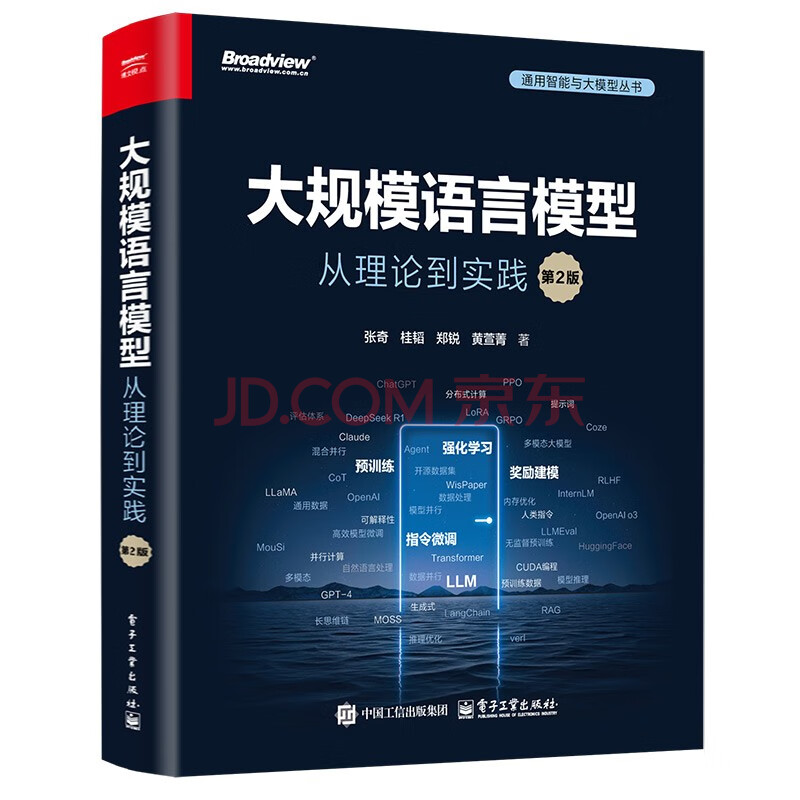

内容简介

本书共12章,围绕大语言模型基础理论、预训练、指令理解、模型增强和模型应用五个部分展开:第一部分介绍大语言模型的基础理论;第二部分介绍大语言模型的预训练,包括大语言模型预训练数据和分布式训练;第三部分介绍大语言模型如何理解并服从人类指令,包括有监督微调和强化学习;第四部分介绍大语言模型增强技术,包括多模态语言模型、大模型智能体和检索增强生成;第五部分介绍大模型应用,包括大模型效率优化、模型评估和应用开发。

精彩书评

随着ChatGPT的问世,大语言模型展现出巨大潜力,对人工智能发展产生了深远影响。面对这一迅速发展的技术,如何快速理解其理论并参与实践是我们必须要面对的挑战。本书在第1版的基础上增加了多模态、智能体、RAG等章节,并对指令微调和强化学习部分进行了大幅修改,旨在帮助读者深入理解大语言模型的原理,提供实操指导,值得阅读。

柴洪峰 中国工程院院士

本书深入解析了大语言模型的基本原理,分析了当前几种有代表性的大语言模型的学理特点,分享了作者在这一领域的实践经验。本书的出版恰逢其时,是学术界和产业界不可多得的读物,将助力读者进一步探索和应用大语言模型。

蒋昌俊 中国工程院院士

本书全面解析了大语言模型的发展历程、理论基础与实践方法,对大语言模型预训练、指令微调、强化学习、多模态、智能体、RAG等前沿领域的研究进展有较好的覆盖。此外,本书深入探讨了大语言模型的实际应用场景与评价方法,为研究者提供了系统的理论指导与实践经验。相信本书对从事相关研究的学者和大语言模型开发者具有重要的参考价值。

周伯文 上海人工智能实验室主任、首席科学家,清华大学惠妍讲席教授

目录

目录

第1章 绪论1

1.1 大语言模型的基本概念1

1.2 大语言模型的发展历程4

1.3 大语言模型的构建流程8

1.4 本书的内容安排10

第2章 大语言模型基础13

2.1 Transformer结构13

2.1.1 嵌入表示层14

2.1.2 注意力层15

2.1.3 前馈层18

2.1.4 残差连接与层归一化19

2.1.5 编码器和解码器结构20

2.2 生成式预训练语言模型GPT 25

2.2.1 自监督预训练25

2.2.2 有监督下游任务微调26

2.2.3 预训练语言模型实践27

2.3 大语言模型的结构32

2.3.1 LLaMA的模型结构33

2.3.2 注意力机制优化39

2.4 混合专家模型46

2.4.1 稀疏混合专家模型47

2.4.2 稠密混合专家模型49

2.4.3 软混合专家模型50

2.5 实践思考51

第3章 大语言模型预训练数据52

3.1 数据来源52

3.1.1 通用数据53

3.1.2 领域数据55

3.2 数据处理56

3.2.1 质量过滤56

3.2.2 冗余去除57

3.2.3 隐私消除58

3.2.4 词元切分59

3.3 数据影响分析64

3.3.1 数据规模64

3.3.2 数据质量66

3.3.3 数据多样性69

3.4 开源数据集70

3.4.1 Pile 70

3.4.2 ROOTS 73

3.4.3 RefinedWeb 75

3.4.4 CulturaX77

3.4.5 SlimPajama 78

3.5 实践思考82

第4章 分布式训练83

4.1 分布式训练概述83

4.2 分布式训练的并行策略85

4.2.1 数据并行86

4.2.2 模型并行90

4.2.3 混合并行98

4.2.4 计算设备内存优化99

4.3 分布式训练的集群架构103

4.3.1 高性能计算集群的典型硬件组成103

4.3.2 参数服务器架构104

4.3.3 去中心化架构105

4.4 DeepSpeed实践110

4.4.1 基础概念112

4.4.2 LLaMA分布式训练实践115

4.5 实践思考126

第5章 指令微调127

5.1 指令微调训练127

5.1.1 指令微调数据127

5.1.2 指令微调数据构建方法129

5.1.3 指令微调数据评估与影响135

5.1.4 指令微调训练策略141

5.1.5 开源指令数据集142

5.2 高效模型微调144

5.2.1 LoRA 144

5.2.2 LoRA的变体148

5.3 模型上下文窗口扩展150

5.3.1 具有外推能力的位置编码150

5.3.2 插值法151

5.4 DeepSpeed-Chat SFT实践153

5.4.1 代码结构155

5.4.2 数据预处理157

5.4.3 自定义模型159

5.4.4 模型训练161

5.4.5 模型推理162

5.5 实践思考162

第6章 强化学习164

6.1 强化学习概述164

6.1.1 强化学习基础概念165

6.1.2 强化学习与有监督学习的区别166

6.2 策略梯度方法168

6.2.1 策略梯度168

6.2.2 REINFORCE算法170

6.2.3 广义优势估计171

6.2.4 近端策略优化算法173

6.2.5 RLOO算法175

6.2.6 GRPO算法177

6.3 推理模型的强化学习179

6.3.1 DeepSeek-R1 179

6.3.2 Kimi k1.5 182

6.4 基于人类反馈的强化学习185

6.4.1 基于人类反馈的强化学习流程185

6.4.2 奖励模型 186

6.5 verl实践191

6.6 实践思考199

第7章 多模态大语言模型200

7.1 多模态大语言模型基础200

7.1.1 典型的多模态大语言模型201

7.1.2 多模态大语言模型的挑战204

7.2 大语言模型与多模态融合架构205

7.2.1 视觉语言模型架构205

7.2.2 语音语言模型架构209

7.2.3 多模态大语言模型架构213

7.3 多模态大语言模型训练策略217

7.3.1 数据处理218

7.3.2 视觉语义关联219

7.3.3 多模态文本对齐220

7.4 MiniGPT-4实践222

7.4.1 MiniGPT-4模型架构222

7.4.2 MiniGPT-4训练策略225

7.5 实践思考229

第8章 大模型智能体231

8.1 智能体基础231

8.1.1 智能体发展历史231

8.1.2 大模型智能体应用范式232

8.2 大模型智能体架构235

8.2.1 感知模块236

8.2.2 规划模块237

8.2.3 记忆模块238

8.2.4 工具使用模块239

8.3 大模型智能体训练241

8.3.1 工具学习241

8.3.2 推理规划244

8.3.3 长期记忆250

8.4

前言/序言

本书共分为12章,围绕大语言模型基础理论、预训练、指令理解、大模型增强和大模型应用五个部分展开:第1部分介绍大语言模型的基础理论;第2部分介绍大语言模型的预训练,包括大语言模型预训练数据和分布式训练;第3部分介绍大语言模型如何理解并服从人类指令,包括指令微调和强化学习;第4部分介绍大语言模型增强技术,包括多模态大语言模型、大模型智能体和检索增强生成;第5部分介绍大模型应用,包括大语言模型效率优化、大语言模型评估和大语言模型应用开发。

第2章介绍大语言模型的基础理论知识,包括语言模型的定义、Transformer结构、大语言模型框架等内容,并以LLaMA使用的模型结构为例介绍代码实例。

第3章和第4章围绕大语言模型预训练阶段的主要研究内容展开介绍,包括模型分布式训练中需要掌握的数据并行、流水线并行、张量并行及ZeRO系列优化方法。除此之外,还将介绍预训练需要使用的数据分布和数据预处理方法,并以DeepSpeed为例介绍如何进行大语言模型预训练。

第5章和第6章聚焦于大语言模型指令理解阶段的核心研究内容,探讨如何通过指令微调和强化学习方法,使模型能够理解指令并生成类人回答。第5章重点介绍模型微调技术、指令微调数据的构造策略以及高效微调方法,如LoRA、Delta Tuning等方法,第6章则围绕强化学习展开,讲解其基础理论与近端策略优化(PPO)技术,并结合实际案例,以DeepSpeed-Chat和verl框架为例,详细说明如何训练类ChatGPT系统。

第7章、第8章和第9章围绕提升大语言模型的能力展开详细探讨,内容涵盖多模态大语言模型、大模型智能体和检索增强生成。第7 章重点介绍多模态大语言模型的基础理论、架构设计与训练策略,并探讨其在实际场景中的应用实践;第8章聚焦于智能体的发展历程与大语言模型智能体的架构设计,深入分析智能体的实现原理,并以LangChain为例详细阐述具体实践;第9章则围绕检索增强生成展开讨论,介绍其核心思想与实现方式,涵盖检索增强框架的设计、检索模块与生成模块的协作机制,以及其在具体任务场景中的应用方法与实践。

第10章、第11章和第12章主要围绕如何应用大语言模型展开讨论,内容涵盖提升模型效率的方法、大语言模型评估,以及大语言模型典型应用的开发与部署。第10章重点介绍模型压缩与优化、训练效率优化和推理效率优化等提升模型效率的关键技术;第11章聚焦于大语言模型评估,探讨其基本概念和难点,阐述评估体系的构建、评估方法的设计及实际评估的实施;第12章则基于典型的大语言模型应用场景,详细介绍其开发流程、开发工具及本地部署的实践方法。